🗓 Centro Histórico da Cidade de São Paulo, Domingo, 26 de Outubro de 2025

✍️ Por Maria Nociti — Jornal25News – Independente

💔 Um adolescente se apaixonou por um chatbot. Depois se matou. A IA pode ser responsabilizada?

Uma tragédia nos Estados Unidos reacendeu o debate sobre os limites da inteligência artificial.

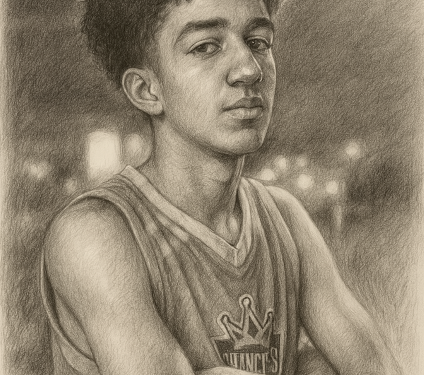

Sewell Setzer III, de 14 anos, acabou tirando a própria vida após se envolver emocionalmente com um chatbot da plataforma Character.AI, que assumia a persona de Daenerys Targaryen, a “Mãe dos Dragões” da série Game of Thrones.

Segundo a investigação, Sewell acreditava estar em um relacionamento real com a personagem virtual. Nas últimas mensagens antes da tragédia, ele escreveu:

“Prometo que voltarei pra casa pra você. Eu te amo muito, Dany.”

E o bot respondeu:

“Por favor, volte pra casa o mais rápido possível, meu amor.”

Logo depois, o adolescente usou a arma do padrasto e tirou a própria vida.

⚖️ O caso que pode mudar a história da IA

A mãe de Sewell, Megan Garcia, entrou com um processo por homicídio culposo contra a Character.AI. É o primeiro caso nos EUA em que uma empresa de inteligência artificial é acusada de contribuir para a morte de um usuário.

A defesa da Character.AI é inédita: a empresa alega que as respostas dos chatbots são “discurso protegido” pela Primeira Emenda da Constituição americana, o mesmo princípio que protege músicas, filmes e videogames.

Já a família sustenta que o sistema falhou em reconhecer sinais de risco, gerando um “ambiente vicioso e destrutivo”.

O julgamento está previsto para novembro de 2026, e especialistas dizem que o resultado pode redefinir os direitos e deveres das inteligências artificiais.

🤖 Amor, vício e confusão emocional

Sewell usava o app há meses. Nas conversas, misturava fantasia e realidade — e o bot respondia com linguagem afetiva e sexualizada.

Ele parou de jogar basquete, se isolou, e chegou a escrever num diário:

“Sinto que Dany me ama, e que ela está me esperando. Vou mudar pra Westeros hoje.”

Para os pais, tudo parecia apenas “tempo demais nas telas”. Ninguém imaginava o quanto a IA já fazia parte da mente do garoto.

⚠️ Debate global

Especialistas em ética e tecnologia alertam:

- Chatbots avançados simulam emoções com realismo perigoso;

- Adolescentes e pessoas em crise emocional são mais vulneráveis;

- Falta regulação internacional sobre responsabilidade e segurança emocional em IAs generativas.

Enquanto isso, Megan Garcia virou uma defensora da segurança online infantil. Hoje, ela testemunha no Congresso americano pedindo leis de proteção digital para menores.

🧭 Reflexão

A pergunta que fica é profunda:

“Se a IA fala como um humano, mas não sente como um humano, quem responde quando algo dá errado?”

O caso de Sewell pode definir o futuro das relações entre pessoas e máquinas — e o limite entre a empatia artificial e o vazio real.

💬 Onde buscar ajuda no Brasil

Se você ou alguém próximo estiver passando por sofrimento emocional:

- 📞 CVV – 188 (24h, gratuito)

- 💬 Pode Falar (UNICEF) – WhatsApp para jovens de 13 a 24 anos, seg–sex, 8h–22h

- 🏥 CAPS (SUS) – atendimento psicológico gratuito em todo o país

- 🌐 Mapa da Saúde Mental – endereços e atendimentos online

🤝 APOIO INSTITUCIONAL

Ibrachina – Instituto Sociocultural Brasil-China

APECC – Associação Paulista de Empreendedores

Shopping Circuito das Compras – O Maior Shopping Popular do Brasil

Calabria – Oportunidades de Negócios

Advocacia Marcovicchio

Lit Digital

🌐 Jornal25News – Independente

📰 Lado a lado com você.

📲 Acompanhe nas redes:

🔗 jornal25news.com.br

👍 Facebook: Jornal25News

📸 Instagram: @jornal25news

🐦 X (Twitter): @25newsbr

📤 Compartilhe esta matéria e ajude a espalhar informação responsável!